Le Léviathan et la cybernétique – Alex Taek-Gwang LEE

L’original a été publié en anglais dans Sublation magazine (revue en ligne), le 24 février 2023 (David Buxton).

Quand j’ai revisité Paris après la pandémie, j’ai trouvé que quelque chose avait changé. Si je devais le pointer, je parlerais du changement climatique et de l’automation. La pluie d’hiver tombait dru, et la température fluctuait sensiblement pendant la journée. Des automates avaient remplacé les caissières dans les supermarchés, et même dans les librairies ; des vigiles dirigeaient les clients vers les machines. Pour un Coréen comme moi, tout cela était familier, mais je n’attendais pas de le trouver à Paris. Il n’est pas surprenant qu’il y ait eu tant de discussions à propos de l’automation en France dernièrement.

Bien entendu, dans une perspective historique, l’impulsion à l’automatisation n’a rien de nouveau. Au début du capitalisme, l’obsession bourgeoise avec les machines était bien connue ; les machines exigeaient la transformation du corps. Le concept marxien de « subsomption formelle » implique la mécanisation du corps, rien de moins, alors que le concept de « subsomption réelle » signifie la soumission volontaire du sujet à cette mécanisation. Quand j’étudiais en Angleterre, j’ai visité un site de la Révolution industrielle que j’ai trouvé étrange. La source la plus importante pour les engins à vapeur qui alimentaient l’industrie était l’énergie hydraulique ; les premières fabriques se trouvaient donc à la campagne. J’étais frappé par la vue des machines, gigantesques mais de faible puissance, qui semblaient déplacées dans le paysage rural, et intrigué par la volonté d’investir des sommes importantes à l’époque dans des machines moins productives que de la main-d’œuvre qualifiée. L’efficacité n’entrait pas en jeu.

L’intérêt bourgeois pour les machines fut donc excessif, et non rationnel. Il s’agissait peut-être d’une conviction ; on ne peut ignorer que Thomas Hobbes voyait la mécanisation comme une question politique, la base d’un « Bien commun » (commonwealth). Son « Léviathan » est un « homme artificiel », un automate. L’obsession bourgeoise des machines sous-tend aussi la doctrine utilitariste. Pour Hobbes, l’État est une machine, un ensemble de forces dont les parties sont représentées par un maître absolu qui incarne le maximum des capacités humaines (1). Hobbes cherchait à théoriser la politique en fonction des accomplissements scientifiques de l’époque ; le Léviathan en est la conséquence. Il importe de noter ici que Hobbes utilise la science (ou plus précisément la méthodologie mathématique) pour extrapoler un élément, l’État, qui existe au-delà de l’expérience humaine.

Contenu

L’État en tant qu’automate

On ne peut jamais connaître l’État en tant qu’individu. Convaincre des individus de la réalité de l’État est donc difficile. Dans l’âge de la science, quand la croyance en un être transcendant, Dieu, a disparu, la seule chose qui peut relier les individus dans une collectivité est, selon Hobbes, la promesse d’un contrat social. Ce qui pose problème, c’est l’évidence d’un tel contrat ; pour Hobbes, la réponse se trouve dans la loi naturelle du désir de « la conservation de son être ». Reste la question : comment savoir que telle est la loi naturelle ? C’est seulement par le savoir qu’on peut la mettre en œuvre. Il n’est pas surprenant que la solution de Hobbes ait été la science, qui passe par des calculs mathématiques comme ceux déployés par Galileo pour tester les lois de la physique. Dans une expérience scientifique, on ne peut voir ces lois directement. Il faut donc formuler une hypothèse, calculer les résultats, et puis les comparer aux résultats de l’expérience pour voir si l’hypothèse est correcte. C’est par cette méthode scientifique que Hobbes croit qu’on peut démontrer les fonctions de l’État qui sont invisibles pour l’individu.

La façon dont l’État nous apparaît aujourd’hui, à travers d’innombrables statistiques et indicateurs nationaux, ne semble pas très différente de l’hypothèse hobbesienne. Comme Foucault l’indique, l’établissement de la philosophie politique libérale marque l’émergence de la gouvernementalité moderne. Le déplacement révolutionnaire dans la perception qui fait de l’égalité des choses la fondation de l’égalitarisme politique était certainement un accomplissement des Lumières, mais il a aussi créé de nouveaux problèmes. En percevant les mécanismes de la politique comme de la représentation, l’équation axiomatique de la représentation avec la politique réelle est devenue normative. Certes, Hobbes souligne la volonté du peuple (représentée par le souverain et non par le parlement), mais les théoriciens libéraux qui l’ont suivi n’hésitaient pas à appréhender la politique à partir des prémisses de sa philosophie. La perception de l’État comme automate était indéniablement un élément clé des Lumières.

Dans ce sens, Hobbes est peut-être le premier philosophe politique à théoriser le rapport entre gouvernance et rationalité technologique. L’État, qu’il appelle le « Bien commun », est un appareil mécanique qui s’opère selon un algorithme ; il est le sujet absolu, la mécanisation artificielle de la puissance de l’individu. Conceptualiser cette représentation comme un tout, tel était le travail de sa vie ; il s’agissait aussi de l’infrastructure technique qui permettait aux individus d’imaginer l’État. La distribution de masse des livres par l’imprimerie s’est avérée cruciale pour l’unification des expériences individuelles en une unité appelée la nation. Les médias de masse ont intensifié encore la révolution cognitive produite par le développement de l’imprimerie. L’appel à l’action, implicite dans la technologie à ses débuts, est encore présent aujourd’hui. Les impératifs du contrat social fonctionnaient comme promesses faites à cette communauté imaginée. Ainsi, la formulation de la philosophie politique est inextricablement liée à la totalisation de la technologie.

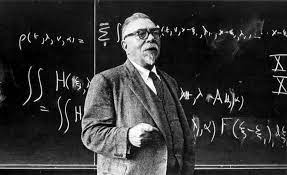

J’affirme que la mécanisation de la motivation humaine sous-tend toutes les théories libérales de l’État depuis la philosophie politique de Hobbes. La finalité de cette mécanisation est l’automatisation de l’État. Cela implique que la biopolitique à la Foucault (le corps politique) ait déjà été immanente dans la cybernétique des Lumières. L’agenda politique qui consiste à subjuguer le désir et le corps à l’État comme une pièce de machinerie, et à les faire travailler ensemble – agenda qui est passé par l’expérience du fascisme -, est devenu le paradigme dominant pour gérer le capital humain après la Deuxième Guerre mondiale (2). Dans les années 1940, Norbert Wiener a perfectionné des modèles mathématiques antérieurs de mécanisation dans sa théorie cybernétique. Conçue au départ comme un système de défense militaire, elle a été largement adoptée comme fondement scientifique de la politique américaine pendant la Guerre froide. De nos jours, elle se trouve au cœur de la technologie numérique. La théorie cybernétique de Wiener a servi de programme technique, et a fonctionné comme un médium technologique pour relier l’individu à l’État, ce qu’avait envisagé Hobbes.

L’inconscient de la cybernétique

En 1955, Jacques Lacan a abordé la question de la cybernétique dans un séminaire consacré à « La Lettre volée », la nouvelle célèbre d’Edgar Allan Poe. Il y indique que la théorie des jeux avait suscité l’intérêt dans divers domaines de la rationalité, de la politique à la théorie de ‘information en passant par la communication. Lacan affirme que le langage est aussi au centre de la cybernétique (et non seulement le traitement de l’information), ce qui permettait à la psychanalyse d’y intervenir (4). Il voit la cybernétique comme « une formation rationalisée des sciences conjecturales », c’est-à-dire que le modèle mathématique fonctionne comme une forme autoréalisatrice qui transforme la contingence en structures algorithmiques. Lacan souligne, cependant, que la psychanalyse est une expression syntactique du réel, à la différence de la cybernétique, qui se focalise sur la construction syntactique du symbolique comme la forme des sciences conjecturales.

Quand Lacan a abordé cette question, la cybernétique existait depuis une décennie. En analysant les modèles mathématiques de cette technologie, Lacan essayait de démontrer qu’il y a quelque chose dans l’imaginaire qui ne peut être détaché du système symbolique à l’œuvre dans le discours humain (5). En effet, quand je relis Lacan aujourd’hui, j’ai l’impression que les débats autour de la cybernétique dans les années 1950 sont à la racine de beaucoup des changements technologiques émergeant autour de l’intelligence artificielle. C’est pourquoi nous devons explorer sérieusement les théories françaises d’après-guerre qui ont traité ces questions. Les débats faisant figurer Lacan, Simondon, Lévi-Strauss, Axelos, Althusser, Foucault, Deleuze et Guattari (pour ne mentionner qu’eux) fournissent toujours une base essentielle d’une contre-théorie à la domination technologique que j’appelle la cybernétique mondiale.

Étant donné que Wiener lui-même voit la cybernétique comme un médium de communication, il est difficile de nier que le modèle mathématique de la théorie du contrôle a eu un impact profond sur notre façon de penser, au-delà du domaine de la technologie. Les réseaux sociaux ont repris le modèle de Wiener et l’ont élargi dans un mode de vie entier. Depuis la venue d’Internet, ce modèle mathématique a acquis un nouveau nom, le numérique, et a préparé le chemin pour l’émergence de la cybernétique mondiale. Plutôt que d’être impulsée par une force particulière, cette approche de l’unification du monde par une norme universelle unique a été un développement coïncidant avec la mondialisation du capitalisme. La conceptualisation récente de Shoshana Zuboff d’un « capitalisme de surveillance » peut être vue comme une autre façon de nommer la montée de la cybernétique mondiale. En fin de compte, je pense que la logique derrière l’acceptation normative de ce paradigme est une réitération contemporaine de la vision de Hobbes d’un État invisible comme modèle scientifique d’une machinerie efficiente.

Dans la définition de Wiener, la cybernétique est un système de contrôle avec deux opérations : la surveillance et le feedback. Les deux principes de l’observation et de la correction sont au cœur de ce mécanisme. Ici, la surveillance est l’œil, et le surveillant, le cerveau ; l’idée est de vérifier si le processus se déroule correctement, et d’éliminer des erreurs par le feedback. En 1948, quand Wiener a inventé le terme cybernétique, il a fondé son idée sur la similarité entre le cerveau et la machine (6), et sur la prémisse de dériver un output à partir d’un input de l’information. Cela correspond à l’idée de Hobbes que le mouvement de toute chose peut être représenté mathématiquement. En ce sens, la distinction entre humains et animaux disparaît, et toute activité vitale devient réductible au comportement des objets, idée transférée à la théorie accompagnant les machines à calculer et les ordinateurs. Un ordinateur est une machine qui enregistre et traite des chiffres, et qui exprime ses résultats numériquement. Wiener a divisé ces machines à calculer primitives en ce qu’on devait appeler analogue et numérique.

Pour Wiener, le numérique, qui opère avec l’opposition binaire de 0 et de 1, augmente la justesse au point d’être autoréalisateur. L’automation numérique fait aligner le hasard aux algorithmes du système (7). Autrement dit, l’algorithmisation de la contingence est la finalité de la cybernétique. La contingence représente l’élément imprévisible qui résiste à l’automatisation ; enlever cette imprévisibilité est la raison d’être de la théorie de Wiener, où la contingence signifie la subjectivité. L’irrationalité de la politique, que Hobbes cherchait à éliminer par l’automatisation de l’État, n’est rien d’autre que la contingence. D’après Wiener, le problème de la contingence est l’intervention humaine. La mise en œuvre d’un mécanisme automatique n’est possible que si des données numériques y sont entrées, et si les calculs sont réglés afin de contrôler tout ce qui passe dans le déroulement du processus. Ainsi, selon Wiener, l’élaboration des algorithmes qui calculent la probabilité du hasard pourrait faire avancer l’automatisation, en créant une autre binaire numérique à même d’algorithmiser les contingences qui subsistent dans l’opération. Un tel processus de génération sans fin serait le véritable mécanisme de l’automatisation.

C’est comme si, au moment où on applique une loi particulière pour résoudre un problème, il faudrait appliquer une autre loi pour résoudre un problème imprévu créé par la loi précédente. Voilà ce que signifie l’impossibilité de détacher l’imaginaire du symbolique. Mettre un éléphant dans un réfrigérateur est possible dans l’imaginaire, mais impossible dans la logique du système symbolique. Une métaphore est comme une fraction de l’imaginaire divisée par le symbolique. En ce sens, une réponse est différente d’une réaction ; recevoir une réponse implique un sujet. Pour Lacan, le langage n’est pas simplement une question de transmettre de l’information. Le Big Data et l’intelligence artificielle décrivent la domination de la cybernétique mondiale. Mais l’état actuel de l’environnement technologique se caractérise par la tension entre les mondes imaginaire et symbolique : toute technologie est là pour être utilisée, et sa signification s’établit par les possibilités ouvertes de son utilisation.

Le syndrome ChatGPT

Une manifestation récente de ce phénomène est le buzz entourant ChatGPT. Le lancement en novembre 2022 (par l’entreprise OpenAI) de ce site opéré par l’intelligence artificielle a fait la une partout, suscitant des questions sur ses conséquences sociales. La technologie qui sous-tend le site est GPT-3, qui s’appuie sur un modèle de langage auto-régressif employant l’apprentissage automatique (deep learning) pour produire du texte « humain » (8). OpenAI sortira GPT-4, plus avancé, au cours de 2023.

Lors d’un atelier international juste avant le lancement de ChatGPT, j’ai discuté avec quelques universitaires travaillant sur des méthodes expérimentales de recherche dans les humanités. Dennis Tenen de l’université de Columbia (New York) y a fait un exposé sur GPT et les études littéraires, concluant que ces dernières devraient se transformer, car la technologie allait changer le concept même d’écriture. Tandis que Tenen voit cela comme un développement positif que l‘enseignement supérieur devrait embrasser, la plupart de mes collègues en humanités et en sciences de l’éducation ne sont pas d’accord. À mesure que cette technologie émergeait, j’ai senti la peur que les méthodes traditionnelles d’enseignement, c’est-à-dire l’évaluation conventionnelle des essais, ne deviennent obsolètes. Si les étudiants soumettaient des essais écrits avec ChatGPT, il serait impossible de les noter, car les détecteurs du plagiat ne fonctionneraient plus.

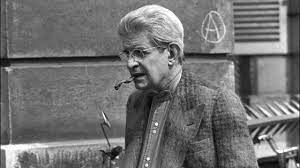

Comme l’a plaisanté Slavoj Zizek, en pareil cas, les enseignants utiliseraient ChatGPT pour noter les étudiants. Dans un esprit ludique, j’ai soumis un texte vite fait à ChatGPT, qui l’a donné une note convaincante en quelques seconds. Cela dit, je ne pense pas qu’il faille prendre cette plaisanterie trop au sérieux. Il serait plus juste de dire que la controverse autour de ChatGPT est symptomatique d’un système d’enseignement supérieur déjà dysfonctionnel.

Selon un article récent dans Nature, ChatGPT ne pose pas problème uniquement pour les enseignants dans les humanités ; il serait contraire à l’éthique d’utiliser ChatGPT pour la rédaction de papiers scientifiques. Sans de vraies sanctions, il constituerait un risque sérieux pour la science elle-même. Le problème est que celle-ci est totalement dépendante du système d’évaluation par les pairs. En d’autres termes, ChatGPT perturbe le système même du savoir dans l’université. Qu’incarne le régime de vérité universitaire de nos jours ? Historiquement, ce régime est fondé sur l’esprit bourgeois de l’éducation qui, comme l’indique Lukács, cherche à perfectionner « le soi idéal ». Voilà le paradoxe de l’idéologie bourgeoise : le développement technologique de ChatGPT est désormais capable de détruire le monde qui l’a fait naître.

On pourrait adopter ici les principes d’accélérationnisme, et souligner la nature révolutionnaire de ChatGPT. Toute avant-garde a son moment anarchique. Le chaos créé est peut-être le moment où les divisions sensorielles que constituent les valeurs conventionnelles deviennent floues. Un enseignant de littérature comme Tenen semble le penser. Mais est-ce vrai ? Pourquoi ChatGPT met-il les modèles du langage humain au centre de la technologie ? N’y a-t-il pas une réaffirmation de l’identité de la cybernétique, qui a émergé comme une formalisation rationnelle de la science spéculative ? Même si tel était le cas, la science spéculative ne pourrait être séparée de l’imagination. La technologie numérique de Kindle (Amazon) est fondée sur l’imagination analogue du livre en papier. Amazon prétend que l’expérience de lire un livre sur l’écran de Kindle est aussi bien que sur la version papier. On pense à Gutenberg disant que la Bible sortie de sa presse était comme le manuscrit original. Mais la technologie ne peut jamais rester dans le royaume de l’imagination ; elle est toujours matérialisée à travers ses multiples usages. L’instrumentalité de la technologie acquiert du sens à travers l’usage, et prolonge son application première. La finalité de la technologie est d’acquérir et de prolonger ce sens.

La question de savoir si la venue de ChatGPT signifie la fin de l’éducation est encore un sujet de débat ; il serait prématuré d’en tirer des conclusions. Je crois que ChatGPT est une technologie comme la voiture sans conducteur ; il existe des limitations techniques qui l’empêchent de remplacer les voitures existantes. Dans la cybernétique, le traitement de l’information est différent des actes de langage d’un sujet. Je pense alors qu’il serait salutaire de tenir compte de l’argument de [l’auteur de science-fiction] Ted Chiang qu’on ne devrait pas s’inquiéter du développement de l’intelligence artificielle en tant que telle, mais plutôt de son application sous le capitalisme. Par curiosité, j’ai demandé à ChatGPT si l’émergence de cette technologie mènera à la mort de l’éducation. Prévisiblement, il a répondu qu’il n’avait pas été conçu à cette fin, n’étant lui-même qu’un simple modèle de langage. « Non » est la réponse que « la formation rationalisée des sciences conjecturales » ne peut jamais donner.

Ce que l’algorithme ne possède pas, c’est la possibilité d’une réponse négative. L’idée que l’éducation disparaisse en raison du développement de l’intelligence artificielle ne peut être dérivée de l’algorithme de ChatGPT. Si on viole la règle, et une singularité se produit qui va contre l’algorithme, l’élément négatif sera traité comme une erreur. On ne pense pas qu’un réfrigérateur soit mélancolique ; s’il tombe en panne, on le fait réparer ou on le jette. Le syndrome ChatGPT démontre que nous sommes tentés de nous définir à travers l’imagination apocalyptique. Prétendre que ChatGPT modifiera ou remplacera l’écriture humaine résulte d’une mentalité qui ignore allègrement que l’écriture n’existe pas que pour transmettre de l’information, mais aussi pour la jouissance d’un sujet. Nous sommes plus attirés par la fin du monde que par la fin du capitalisme, car l’imaginaire actuel nous situe comme faisant partie d’une humanité destinée à disparaître. Aucune rationalisation de la fin du capitalisme ne peut dépasser cet imaginaire. Ce dont nous avons besoin, alors, c’est un autre imaginaire qui va au-delà de cette vision apocalyptique. Ce que Lukács cherchait en fin de compte dans sa Théorie du roman, c’était une autre étoile pour remplacer l’étoile déclinante de la période classique. Le remplacement de l’imagination apocalyptique par une nouvelle étoile marquerait l’émergence de la politique incalculable que la cybernétique des Lumières cherchait à exclure.

Notes

1. Thomas Hobbes, Léviathan, Folio, 2000 (1651).

2. Pour une discussion intéressante de cela, voir le chapitre 4 de Johann Chapoutot, Libres d’obéir : le management, du nazisme à aujourd’hui, Gallimard, 2020.

3. Jacques Lacan, Écrits, Seuil, 1966.

4. Jacques Lacan, « Psychanalyse et cybernétique », Le séminaire, livre II, le moi dans la théorie de Freud et la technique de la psychanalyse (1954-55), Seuil, 1977.

5. Ibid.

6. Norbert Wiener, La Cybernétique. Information et régulation dans le vivant et la machine, Seuil, 2014 (1948).

7. Ibid.

8. GPT est l’acronyme de Generative Pre-Trained Transformer (Transformateur génératif préformé) (NdT).

Sur la cybernétique dans la Web-revue :

1.Imane Sefiane, « De « Neuromancien » à « Matrix » : les particularités de l’esthétique cybernétique », janv. 2014.

2.Jordan S. Carroll, « Pour comprendre Elon Musk, il faut avoir lu Robert Heinlein », janv. 2023.

Sur le capitalisme de surveillance :